DeepSeek-V4 技术报告(英).pdf

DeepSeek-V4 系列模型在下一代大规模语言模型(LLM)的效率方面取得了突破性进展,特别是在超长上下文处理能力上。该系列模型引入了多项关键创新,包括:

1. **混合注意力机制**:结合了压缩稀疏注意力(CSA)和重度压缩注意力(HCA),显著提高了处理长上下文的效率,使得支持百万级 token 上下文成为可能。

2. **流形约束超连接(mHC)**:对残差连接进行了升级,以增强模型建模能力和训练稳定性。

3. **Muon 优化器**:一种新的优化器,用于加速收敛和提高训练稳定性。

DeepSeek-V4 系列模型包括 DeepSeek-V4-Pro(1.6T 参数,49B 激活)和 DeepSeek-V4-Flash(284B 参数,13B 激活)。这些模型在超过 32T 的多样化高质量 token 数据集上进行了预训练,并通过全面的训练后流水线进行了优化。

**关键优势和性能表现**:

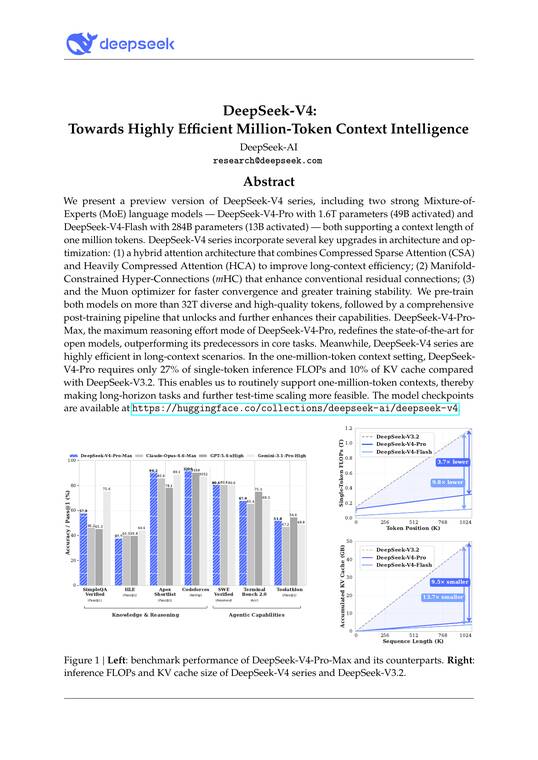

* **长上下文效率**:在百万 token 上下文场景下,DeepSeek-V4-Pro 的单 token 推理 FLOPs 仅为 DeepSeek-V3.2 的 27%,KV 缓存占用仅为 10%。DeepSeek-V4-Flash 表现更佳,FLOPs 仅为 DeepSeek-V3.2 的 10%,KV 缓存占用为 7%。

* **性能卓越**:DeepSeek-V4-Pro-Max(DeepSeek-V4-Pro 的最大推理模式)在众多基准测试中超越了现有的开源模型,并在知识、推理、编码和长上下文理解等方面取得了最先进的性能。它在知识密集型任务上大幅领先,推理能力接近前沿专有模型。

* **高效的架构**:DeepSeek-V4-Flash 在参数量远小于 DeepSeek-V3.2 的情况下,在各种基准测试中都取得了更优的性能,展现了其高效的架构设计。

* **多模态能力**:未来将探索集成多模态能力。

* **Agentic AI 表现**:在 Agentic AI 任务中,DeepSeek-V4 系列展示了强大的性能,特别是在代码代理任务中,表现与 K2.6 和 GLM-5.1 相当。

**技术创新**:

* **混合注意力**:CSA 和 HCA 的组合,通过压缩 KV 缓存和稀疏注意力,大幅降低了计算成本。

* **Manifold-Constrained Hyper-Connections (mHC)**:通过约束残差映射矩阵在流形上,增强了模型的数值稳定性和表达能力。

* **Muon 优化器**:为大规模训练引入的优化器,提高了收敛速度和稳定性。

* **高效的计算与通信重叠**:通过精细的专家并行(EP)方案,实现通信与计算的流水线重叠,隐藏了通信延迟。

* **TileLang 开发**:使用 TileLang DSL 来开发高效且易于维护的内核。

* **FP4 量化感知训练**:加速推理并减少内存占用。

* **支持百万 token 上下文**:通过混合注意力、KV 缓存管理等技术实现。

DeepSeek-V4 系列代表了在长上下文理解、模型效率和整体性能方面的重大飞跃,为下一代 LLM 的发展奠定了基础。

相关报告

-

3.89 MB 46页 2024年十大新兴技术报告(英)-世界经济论坛-2024.6-46页.pdf

-

1.08 MB 98页 2023年GPT-4技术报告(英)-OpenAI.pdf

-

7.52 MB 235页 联合国-2023年技术与创新报告(英译中).pdf

-

959.49 KB 98页 GPT-4技术报告(英)-2023-98页-20230317.pdf

-

19.86 MB 167页 德勤:2021年技术趋势报告(英).pdf

-

7.31 MB 82页 2026年日化用品(洗衣粉)产业:专利导航与技术战略深度诊断报告260428.pdf

-

16.13 MB 138页 2026年AI趋势报告(中英双语版)-statworx(1).pdf

-

2.76 MB 56页 AI指数:人工智能国家能力测度框架技术报告.pdf

-

6.71 MB 59页 AI视频行业深度报告:技术跃迁驱动内容革命,把握产业变革新机遇.pdf

-

3.03 MB 143页 2026年技术趋势报告:定义未来企业竞争力的12大关键技术.pdf

-

1.57 MB 17页 2026年零售和消费品行业AI发展现状及趋势报告-英伟达-202601.pdf

-

6.25 MB 30页 2026年中国春节消费洞察前瞻趋势报告(报告节选)-英敏特-202601.pdf

-

14.46 MB 34页 2026十大AI技术趋势报告-智源研究院-202601.pdf

-

1.13 MB 21页 2025年中国婴幼儿护理用品趋势洞察报告-英敏特-202512.pdf

-

4.49 MB 54页 2025年AI技术如何重构人才获取全链路报告.pdf

-

4.44 MB 63页 中国高端消费新趋势报告(英文).pdf

-

6.67 MB 33页 2026年全球美容与个人护理趋势预测报告-英敏特-202510.pdf

-

17.29 MB 36页 2026年全球消费者趋势预测报告-英敏特-202510.pdf